背景

亲爱的客户,模型提供方将在5月15日至8月30日期间,为您提供一次独特的机会,即高达5亿tokens的免费权益。这是我们对您长期支持的感谢,也是对未来合作的期待。

豆包模型开通

开通模型服务

开通地址:点击

新增模型接入点

这里的名称可以随意定义,接入模型选择你需要的模型

创建成功之后,进入到接入点内,记住ID(后期API接口调用的其实是这个)

创建API

OneAPI部署

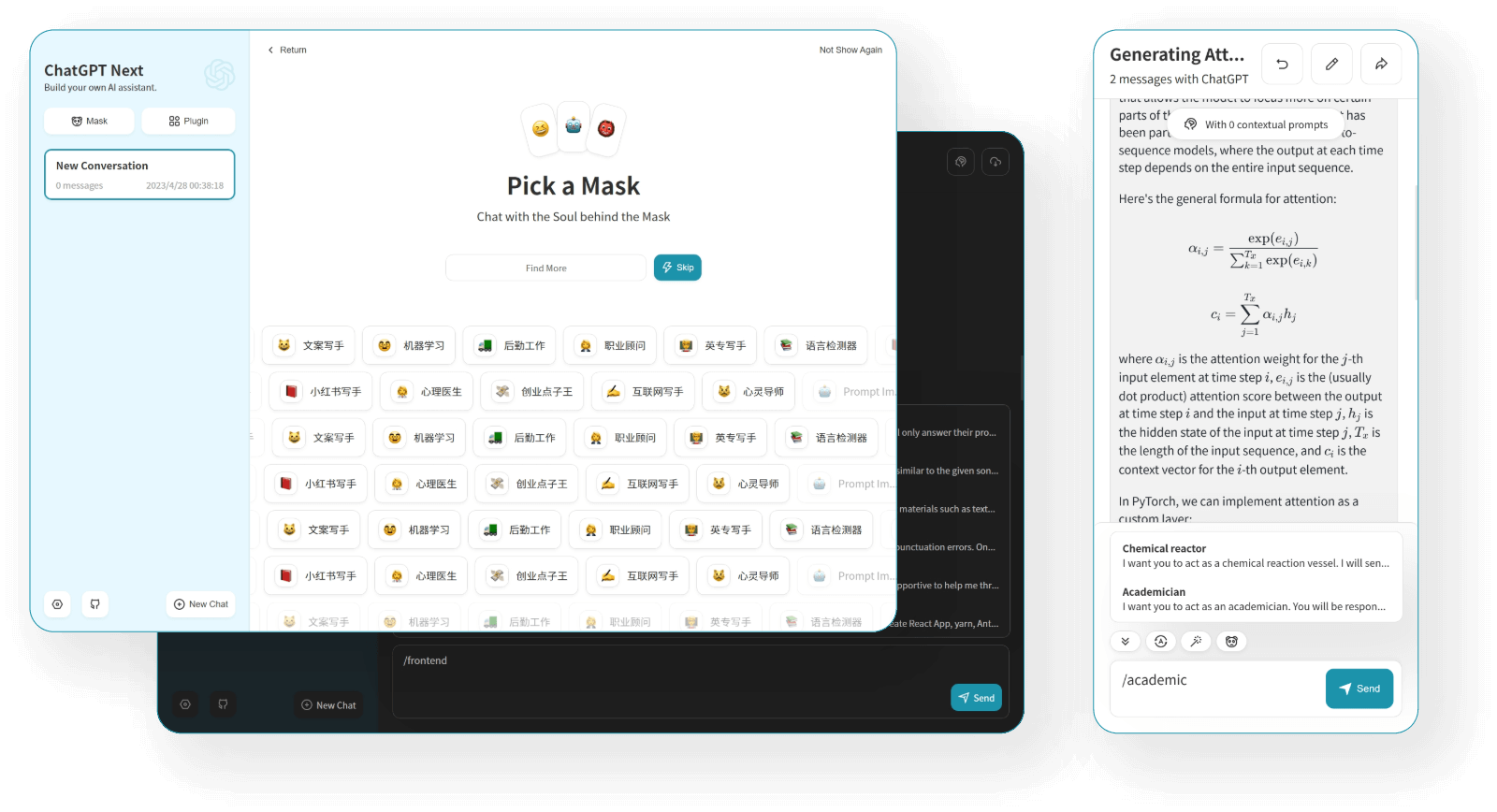

通过将 One API 与 NextChat 或 Lobe Chat 集成,你可以使用你的 API 密钥和自定义 GPT 提示部署你自己的私有 ChatGPT 实例。

主要特点

一个密钥,多个提供商:使用一个 API 密钥即可访问各种 LLM 提供商和模型。

私有且可共享:为自己设置一个私有的 ChatGPT,或邀请朋友和家人享受你的自定义 AI 平台。

易于部署:这两个项目都已容器化,感谢 Docker,使用

docker-compose可以直接部署。

部署

Github:https://github.com/songquanpeng/one-api

docker run --name one-api -d --restart always -p 3000:3000 -e TZ=Asia/Shanghai -v /home/ubuntu/data/one-api:/data justsong/one-api上面的是官方配置,下面的是我的配置

这个很简单,没有太多的,具体的其他参数可以去官方找

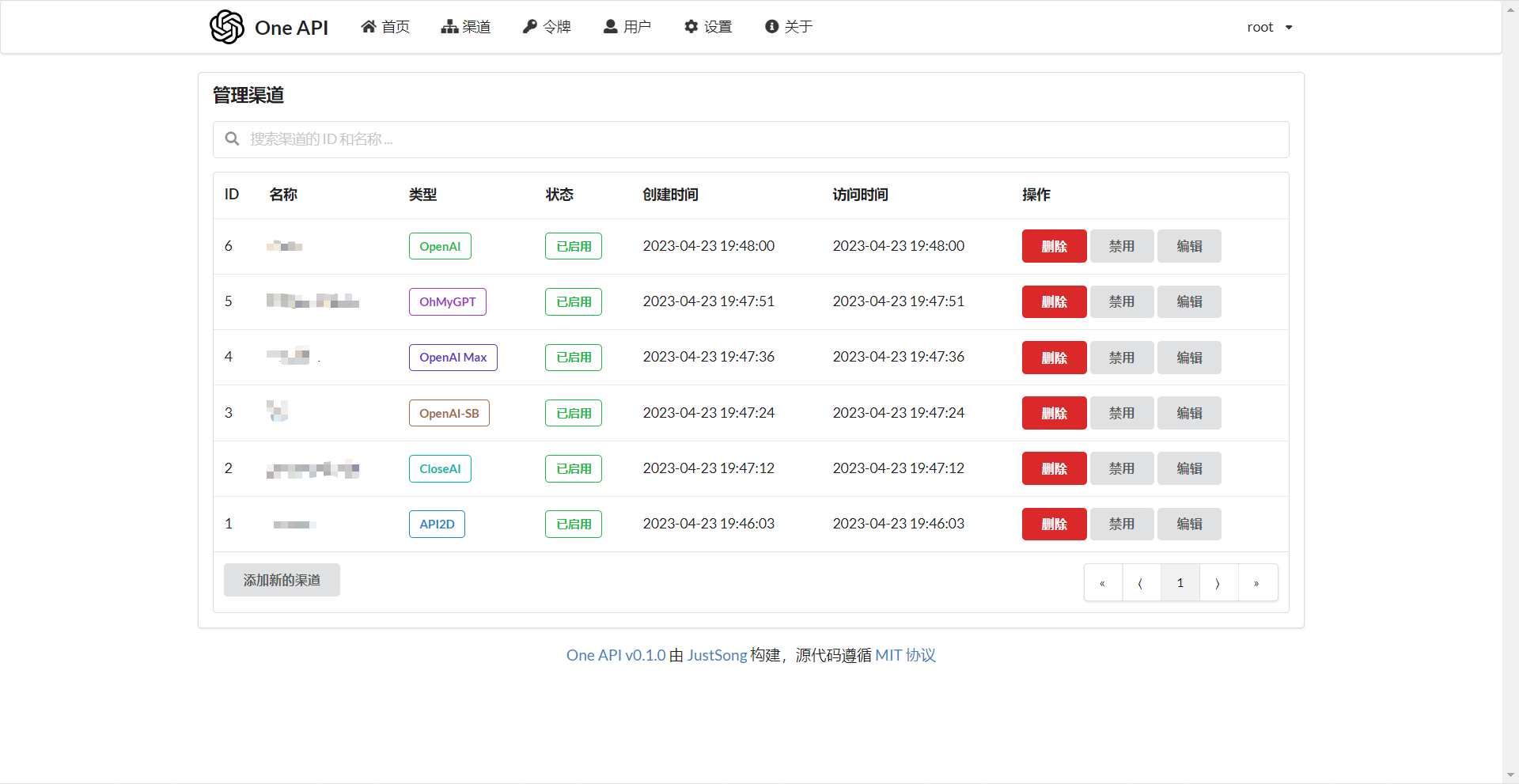

接入渠道

点击添加新的渠道

选择对应的Doubao模型 ,这里大家可以看到我还添加了两个自定义模型,后面我等会会讲到

模型重定向

注意:这里的后面的Value其实就是刚才创建“接入点”的ID

{

"Doubao-pro-4k": "ep-202408xxxxxx-xxxxx",

"Doubao-pro-32k": "ep-202408xxxxxx-xxxxx",

"Yantao_Doubao_32k": "ep-202408xxxxxx-xxxxx",

"Yantao_Doubao_128k": "ep-202408xxxxxx-xxxxx",

"Doubao-pro-128k": "ep-202408xxxxxx-xxxxx",

"Doubao-lite-4k": "ep-202408xxxxxx-xxxxx",

"Doubao-lite-32k": "ep-202408xxxxxx-xxxxx",

"Doubao-lite-128k": "ep-202408xxxxxx-xxxxx"

}

ChatGPT_Next_Chat

我是用这个项目来作为对话的:NextChat_Web

NextChat,以前称为 ChatGPT Next Web,是一款为 OpenAI 服务设计的前沿跨平台 Web 客户端。它超越了标准的聊天界面,为渴望更定制化 AI 交互的用户提供了增强功能。

主要特点

自定义指令和提示:使用自定义 GPT 指令和提示快捷方式定制你的 AI 体验。

内置代理:享受各种带有不同指令和提示的内置代理。

可调整参数:通过设置诸如

temperature、max_tokens、top_p和attached message count等参数来微调你的对话。更高级别的定制:与标准 ChatGPT 相比,NextChat 提供了更个性化的触感,迎合了希望更多地控制其 AI 交互的用户。

PWA 支持:该网络应用程序可以作为 PWA(渐进式网络应用程序)安装在你的设备上,从而获得更原生的体验。

部署

docker run

-d

--name='Chatgpt_NextChat_Web'

--net='br0'

--ip='192.168.200.139'

-e TZ="Asia/Shanghai"

-e HOST_OS="Unraid"

-e HOST_HOSTNAME="AlmightyYantao"

-e HOST_CONTAINERNAME="Chatgpt_NextChat_Web"

-e 'OPENAI_API_KEY'='sk-xxxxxxx'

-e 'CODE'='xxxxxxx'

-e 'BASE_URL'='http://192.168.200.136:3000'

-e 'HIDE_USER_API_KEY'='1'

-e 'DEFAULT_MODEL'='Yantao_Doubao_32k'

-e 'CUSTOM_MODELS'='-all,+Yantao_Doubao_32k,+Yantao_Doubao_128k'

-l net.unraid.docker.managed=dockerman 'yidadaa/chatgpt-next-web'这里主要讲一下,为什么只用自定义模型?主要原因是因为Doubao模型这个项目只支持原生的,不支持OneAPI的。

因此我是新增了两个自定义模型来对应Doubao的两个模型

{

"Yantao_Doubao_32k": "ep-202408xxxxxx-xxxxx",

"Yantao_Doubao_128k": "ep-202408xxxxxx-xxxxx"

}同时将其他不能使用的模型,全部移出,利用CUSTOM_MODELS变量